A IA nas eleições de 2026 muda a disputa pelo voto porque permite campanhas mais baratas, rápidas e personalizadas. O Tribunal Superior Eleitoral (TSE) já definiu regras para o uso da tecnologia, mas o impacto imediato é outro: a propaganda pode chegar ao eleitor com aparência comum e estratégia invisível.

O risco não está apenas em vídeos falsos. A inteligência artificial pode ser usada para manipular voz, imagem, texto, dados e contexto, criando mensagens sob medida para públicos diferentes. A campanha oficial começa em 16 de agosto, antes do primeiro turno em 4 de outubro e de eventual segundo turno em 25 de outubro.

Nas eleições de 2026, o eleitor votará, nesta ordem, para deputado federal, deputado estadual ou distrital, duas vagas ao Senado, governador e presidente da República.

O ministro Nunes Marques presidirá o TSE durante as eleições, com André Mendonça na vice-presidência. O comando importa porque será a primeira eleição geral sob regras mais específicas para IA, propaganda sintética e fiscalização digital.

Como a IA muda a forma de convencer o eleitor

A inteligência artificial permite produzir muitas versões de uma mesma campanha em pouco tempo. Uma equipe pode testar abordagem econômica, linguagem emocional, peça visual, roteiro de vídeo e chamada de anúncio antes de escolher o formato com maior resposta.

Esse ganho muda a lógica da propaganda eleitoral. A campanha deixa de depender apenas de grandes peças públicas e passa a operar com variações discretas, calibradas por tema, região, faixa etária, interesse e comportamento digital.

O ponto sensível é a transparência. Quando o conteúdo não deixa claro que foi fabricado, manipulado ou distribuído com apoio de automação, o eleitor perde parte da capacidade de entender quem tenta influenciá-lo e por qual método.

O que são eleitores sintéticos

Eleitores sintéticos são perfis simulados a partir de padrões de comportamento, dados demográficos, interesses e reações prováveis. Eles não são pessoas reais, mas modelos usados para prever como grupos podem responder a temas, frases, imagens ou ataques.

Na prática, esses modelos funcionam como laboratório de campanha. Uma equipe pode comparar mensagens antes de levá-las ao público real, estimar rejeição, medir apelo emocional e selecionar argumentos com maior chance de adesão.

A tensão eleitoral está no uso dessa previsão para criar comunicação assimétrica. Um grupo pode receber promessa sobre renda, outro sobre segurança, outro sobre costumes, sem que todos enxerguem o conjunto completo da estratégia.

O que o TSE já regulamentou

O Artigo 9º-B da Resolução TSE nº 23.610/2019, alterada pela Resolução TSE nº 23.755/2026, determina que propaganda eleitoral com conteúdo sintético multimídia gerado por IA ou tecnologia equivalente tenha aviso explícito, destacado e acessível.

A regra alcança imagem, vídeo, áudio, som, material impresso e peças audiovisuais. O aviso deve informar que o conteúdo foi fabricado ou manipulado e indicar a tecnologia usada.

A norma também proíbe novos conteúdos sintéticos com imagem, voz ou manifestação de candidata, candidato ou pessoa pública nas 72 horas antes e 24 horas depois do pleito, mesmo quando houver identificação.

O TSE veda deepfake para favorecer ou prejudicar candidatura. Conteúdo irregular deve ser removido imediatamente, sem prejuízo de multa de R$ 5 mil a R$ 30 mil e possível cassação em casos graves de abuso de poder político e uso indevido dos meios de comunicação.

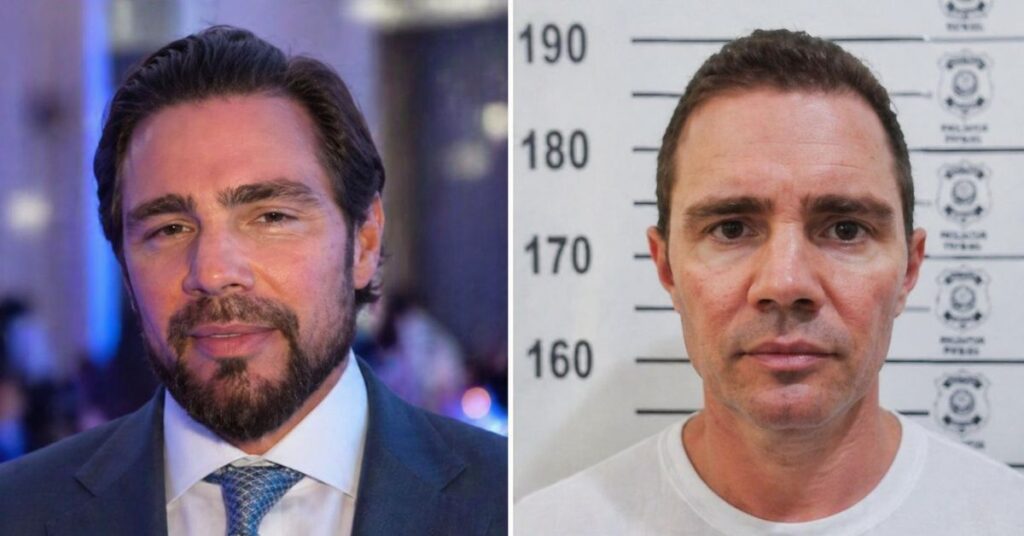

Por que deepfake é só parte do problema

Deepfake é a fraude mais reconhecível porque tenta simular uma pessoa dizendo ou fazendo algo que não ocorreu. Pode envolver clonagem de voz, alteração de rosto, montagem de vídeo ou combinação de áudio e imagem.

Mas o uso ilícito de IA não depende sempre de falsificação visual perfeita. O risco também aparece em fake news geradas em escala, imagens fabricadas, legendas enganosas, recortes fora de contexto, perfis automatizados e ataques coordenados contra adversários.

A diferença é relevante. Deepfake tenta fabricar evidência. A manipulação menos visível tenta alterar percepção, prioridade e emoção sem necessariamente criar um vídeo falso. É nesse campo que a fiscalização encontra maior dificuldade.

Como a personalização invisível desafia a fiscalização

A fiscalização eleitoral funciona melhor quando a peça é pública, identificável e rastreável. A IA complica esse modelo porque permite distribuir conteúdos diferentes para audiências menores, com menor exposição ao contraditório.

O problema não é apenas verificar se uma imagem foi criada por máquina. A questão é saber quem financiou a peça, qual público recebeu o conteúdo, quais dados orientaram a segmentação e se houve distorção deliberada.

Essa opacidade afeta a competição política. Candidatos, Justiça Eleitoral, imprensa e eleitores podem enxergar apenas fragmentos de uma operação maior, formada por mensagens difíceis de comparar entre si.

Como o eleitor pode identificar e denunciar conteúdo suspeito

O eleitor não deve presumir que sempre conseguirá reconhecer IA. A tecnologia pode deixar poucos sinais aparentes, especialmente em áudio curto, imagem estática, montagem simples ou texto produzido para parecer espontâneo.

Alguns sinais exigem cautela:

- ausência de identificação em conteúdo com aparência sintética;

- voz ou rosto de candidato sem fonte confiável;

- mensagem alarmista perto da votação;

- pedido urgente de compartilhamento;

- peça sem autoria clara;

- conteúdo recebido apenas em grupo fechado;

- acusação grave sem documento, link oficial ou fonte verificável.

A denúncia deve priorizar evidência. O ideal é guardar link, captura de tela, data, horário, perfil de origem e contexto de circulação. O Sistema de Alerta de Desinformação Eleitoral recebe comunicações sobre conteúdos suspeitos, inclusive uso irregular de IA.

A IA nas eleições de 2026 não torna a campanha digital proibida. O alerta é mais específico: a tecnologia pode aumentar a eficiência das candidaturas enquanto reduz a visibilidade sobre como cada eleitor é abordado, testado e convencido.